Meta ha lanzado un innovador proyecto llamado Segment Anything, cuyo objetivo es facilitar y democratizar la segmentación de imágenes mediante un modelo generalizable que se adapte a diferentes tareas específicas. Este modelo, conocido como Segment Anything Model (SAM), ha sido entrenado en un conjunto de datos compuesto por más de mil millones de máscaras de segmentación, denominado SA-1B, lo cual lo convierte en el conjunto de datos más grande en su tipo hasta ahora.

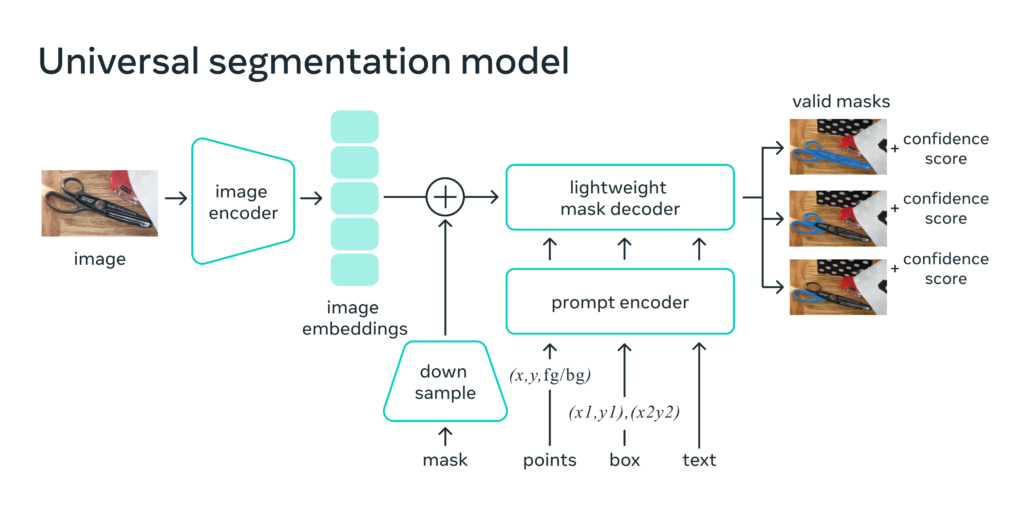

SAM funciona como una interfaz basada en prompts, es decir, puede utilizar cualquier información proporcionada para generar una máscara válida que permita segmentar objetos específicos en imágenes o videos. Su diseño permite una aplicación versátil y adaptable a diversos campos, desde la edición fotográfica y videográfica hasta la investigación científica y agrícola.

Potencialidades del SAM y su impacto en múltiples áreas

La capacidad generalizable del SAM ofrece posibilidades ilimitadas para su aplicación práctica. En el ámbito fotográfico y videográfico, este modelo podría simplificar procesos como la eliminación o sustitución del fondo, así como también permitiría resaltar elementos particulares dentro de las composiciones visuales con mayor precisión.

A nivel científico, el SAM puede contribuir significativamente a la investigación. Por ejemplo, podría emplearse para analizar rápidamente imágenes médicas o biológicas, identificar patrones en datos geográficos o incluso facilitar la detección de anomalías en imágenes astronómicas. En el campo de la agricultura, este modelo podría utilizarse para evaluar con precisión las condiciones de los cultivos y detectar problemas como plagas o enfermedades, lo que permitiría tomar decisiones más informadas y mejorar la eficiencia agrícola.

El conjunto de datos SA-1B: un recurso invaluable para el avance de la IA

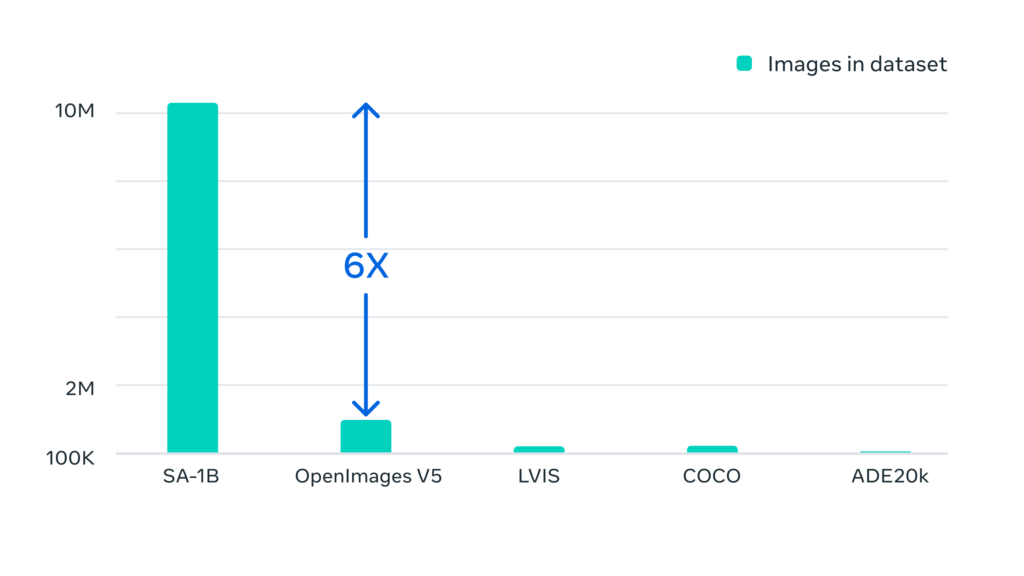

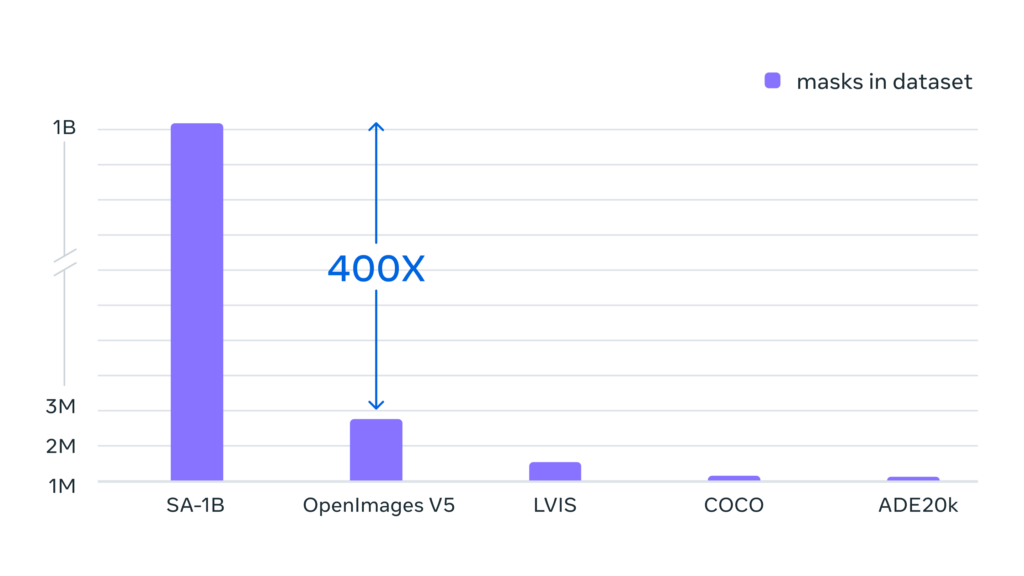

El conjunto de datos SA-1B, utilizado para entrenar al Segment Anything Model, es una herramienta fundamental en el desarrollo del proyecto. Al contar con más de mil millones de máscaras de segmentación, se convierte en un recurso único e invaluable para impulsar investigaciones relacionadas con modelos fundamentales en visión por computadora y sistemas basados en inteligencia artificial.

Dado su tamaño y diversidad, el SA-1B permite a los investigadores explorar nuevas técnicas y metodologías que podrían resultar cruciales para mejorar aún más las capacidades del SAM. Además, su disponibilidad pública fomenta la colaboración entre distintos equipos científicos y tecnológicos interesados en avanzar hacia sistemas generales y multimodales basados en inteligencia artificial.

Versión preliminar del SAM: un impulso a la investigación y desarrollo

Con el lanzamiento del conjunto de datos SA-1B y una versión preliminar del Segment Anything Model, Meta busca estimular avances significativos tanto en el campo específico como generalizado. Al poner estas herramientas al alcance del público científico e investigador, se espera que se generen nuevas aplicaciones y mejoras en el modelo, así como también una mayor comprensión de los fundamentos de la visión por computadora.

El éxito del proyecto Segment Anything podría marcar un hito en el desarrollo de tecnologías avanzadas basadas en inteligencia artificial. Su capacidad para adaptarse a múltiples campos y tareas específicas lo convierte en un recurso valioso para profesionales e investigadores de todo el mundo, quienes podrán beneficiarse de sus posibilidades prácticas y teóricas.

Te dejamos el vídeo de DOTCSV en el que explica las peculiaridades de este nuevo modelo presentado por Meta.

Únete al avance científico y tecnológico con Segment Anything

Ahora que conoces las potencialidades del proyecto Segment Anything y su impacto en diversos campos, es momento de involucrarte con esta revolucionaria iniciativa. Explora las posibilidades que ofrece el conjunto de datos SA-1B, experimenta con la versión preliminar del SAM e impulsa tus propias investigaciones o aplicaciones prácticas utilizando este innovador modelo basado en inteligencia artificial.

No pierdas la oportunidad de contribuir al avance científico y tecnológico global mediante la exploración y aplicación del Segment Anything Model (SAM). Participa activamente en la creación de sistemas más generales, multimodales e inteligentes que puedan transformar nuestra percepción sobre cómo interactuamos con imágenes y videos a través del poderoso legado dejado por Meta.