Meta ha presentado Voicebox, un nuevo modelo de IA de lenguaje generativo capaz de realizar tareas de generación de voz, incluso sin entrenamiento contextualizado. Está diseñado para proporcionar voces naturales a asistentes virtuales, personajes no jugables en el metaverso y ayudar a personas con discapacidad visual a oír los mensajes recibidos. Voicebox se considera un avance significativo en la IA generativa para voz, ya que puede realizar tareas como edición, creación de muestras, estilización e incluso tareas para las que no fue entrenado específicamente mediante aprendizaje contextualizado.

El modelo puede producir clips de audio de alta calidad a partir de una muestra de dos segundos y editar audio pregrabado para mejorar la claridad de la voz en medio del ruido de fondo. Además, Voicebox es multilingüe y admite la producción de voz en seis idiomas: inglés, francés, alemán, español, polaco y portugués.

Desarrollo e innovaciones técnicas detrás del proyecto

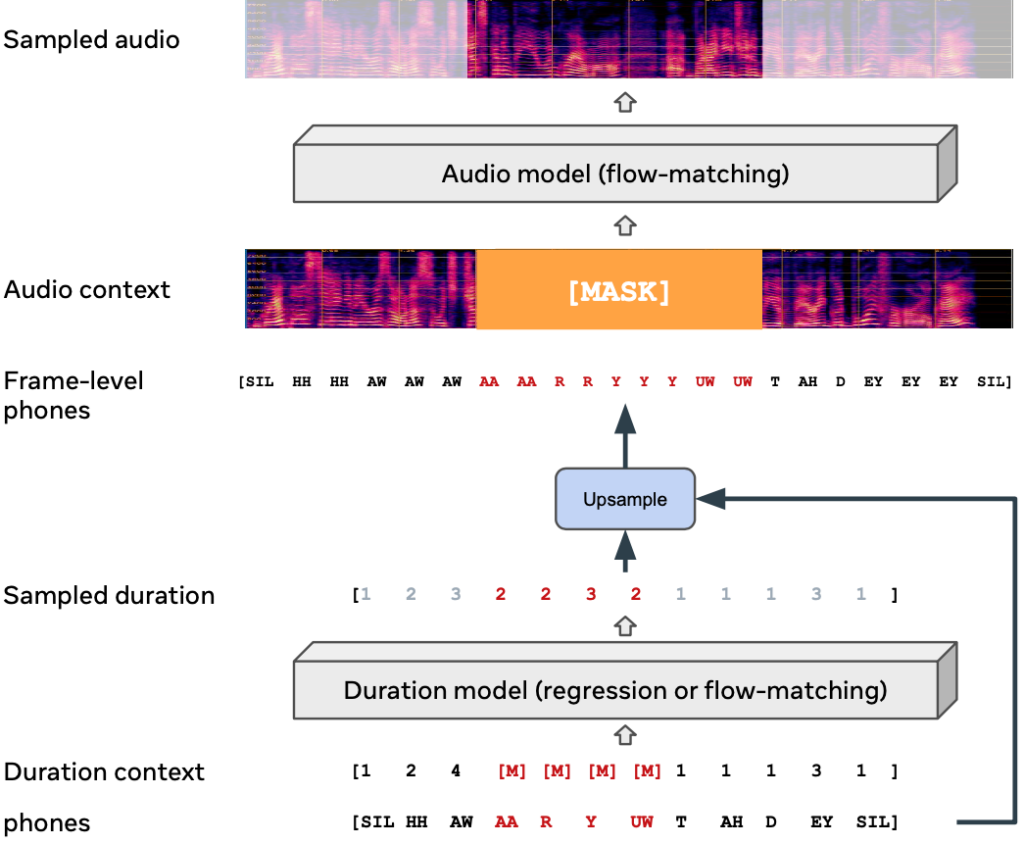

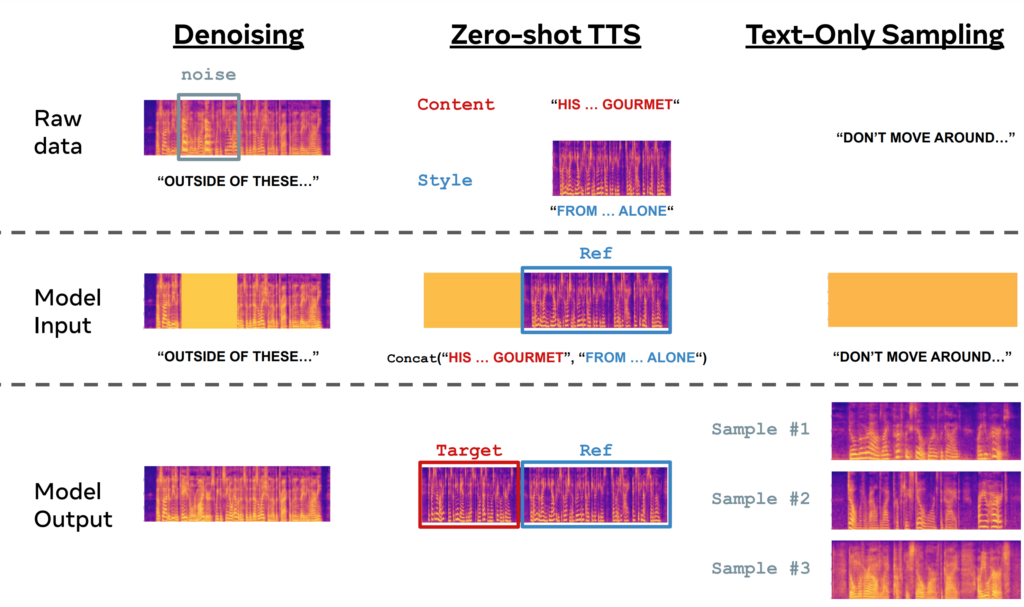

Los investigadores de Meta AI han desarrollado Voicebox, un modelo generativo de IA para el habla que puede generalizarse a tareas de generación del habla para las que no fue entrenado específicamente. Supera a los modelos más avanzados en cuanto a rendimiento, velocidad y versatilidad. Voicebox puede sintetizar el habla en seis idiomas, eliminar ruidos, editar contenidos, convertir estilos y generar diversas muestras. Se basa en un método llamado Flow Matching y logra resultados de vanguardia en cuanto a tasa de error de palabra y métricas de similitud de estilos de audio.

Aunque el modelo y el código no están a disposición del público debido a posibles riesgos de uso indebido, se han compartido muestras de audio y un documento de investigación en el que se detallan el enfoque y los resultados.

Aplicaciones prácticas para Voicebox

Voicebox presenta una serie de casos prácticos que demuestran su potencial para mejorar la comunicación humana mediante la IA:

1. Síntesis de texto a voz en contexto: Voicebox puede adaptar el estilo de audio a partir de una breve muestra y utilizarlo para generar texto a voz, lo que podría ayudar a las personas que no pueden hablar o personalizar las voces de los asistentes virtuales.

2. Transferencia multilingüe de estilos: Dada una muestra de voz y un texto en distintos idiomas, Voicebox puede producir una lectura del texto en el idioma correspondiente, facilitando la comunicación natural.

3. Eliminación de ruido y edición del habla: Voicebox puede editar sin problemas segmentos dentro de grabaciones de audio sustituyendo o resintetizando palabras corruptas o mal pronunciadas.

4. Muestreo diverso del habla: Voicebox genera habla que representa cómo hablan las personas en situaciones reales, lo que ayuda a entrenar los modelos de reconocimiento del habla y a reducir las tasas de error.

Responsabilidad y ética en la investigación

El equipo detrás de Voicebox está comprometido con compartir la investigación de forma responsable. Por ello, el modelo y el código no están a disposición del público debido a posibles riesgos de uso indebido. No obstante, se han compartido muestras de audio y un documento de investigación en el que se detallan el enfoque y los resultados para avanzar en el estado de la técnica y fomentar el desarrollo responsable de la IA.

Además, se ha creado un clasificador muy eficaz para distinguir entre el habla auténtica y el audio generado con Voicebox, mitigando así los riesgos potenciales.

La presentación de Voicebox por parte de Meta marca un hito importante en el avance hacia una comunicación más natural e inclusiva mediante la inteligencia artificial. ¿Cómo crees que este tipo de tecnologías pueden impactar nuestra vida cotidiana? ¿Qué otras aplicaciones podrían surgir a partir del desarrollo continuo de modelos generativos como Voicebox?

Más información: Paper e información oficial